Data & algoritmes: mogelijkheden benutten versus risico's beperken

Data & algoritmes: mogelijkheden benutten versus risico's beperken

Dat overheidsorganisaties veilig en verantwoord gebruik moeten maken van data lijkt een open deur. Toch is het ingewikkelder dan gedacht, zeker als er gebruik wordt gemaakt van algoritmes. Maar hoe doe je dit dan als overheidsorganisatie? Alex Commandeur (BMC) en Hans Spaan (ORTEC) werpen licht op de zaak. ‘Kijk naar je opgave en bedenk op basis daarvan wat je nodig hebt.’

Veilig en verantwoord gebruik van data

De digitale transformatie biedt dus kansen, maar er zijn ook risico’s. Veilig en verantwoord gebruik van data is volgens beiden dan ook van essentieel belang voor datagedreven organisaties. ‘De Algemene Verordening Gegevensbescherming (AVG) verplicht dit zelfs’, aldus Commandeur. ‘De AVG stelt bijvoorbeeld dat organisaties een risicoanalyse moeten doen om aan te tonen dat ze hun data veilig en verantwoord gebruiken. Ook moeten ze transparant zijn over hun datagebruik. Dat betekent uitleggen, verantwoorden en laten zien wat je ermee doet. Dit vergroot ook het draagvlak voor de uitkomsten van data-analyses.’ Spaan vult aan: ‘De AVG is natuurlijk niet het enige. Als organisatie wil je ook in control zijn. Want als het mis gaat, loop je reputatieschade op. Denk aan datalekken na een aanval van hackers, zoals onlangs gebeurde bij gemeente Hof van Twente.’

Risico’s zo veel mogelijk beperken

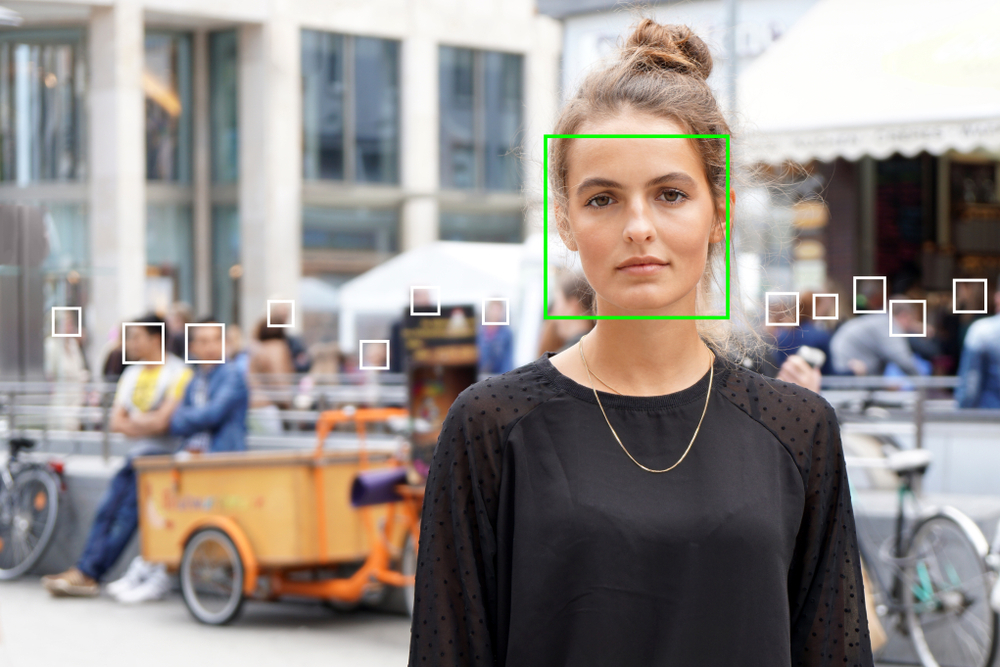

Commandeur stelt dat risico’s niet geheel zijn uit te sluiten ‘Maar je kunt ze wel zo veel mogelijk beperken. Bijvoorbeeld door een Data Protection Impact Assessment (DPIA) te doen. Daarmee krijg je als organisatie inzicht in de rechtmatigheid van het gebruik van data, de beveiliging en de risico’s die aan het verwerken van de data verbonden zijn. In de dagelijkse praktijk van BMC merken we dat DPIA’s overheden ook helpen om vooraf scherp in beeld te krijgen welke opgave ze willen realiseren en hoe data daarbij kunnen helpen. Maar ook welke mogelijke risico’s er zijn voor de betrokkenen. Bijvoorbeeld bij het gebruik van algoritmes.’ Waarom is het gebruik van algoritmes dan zo risicovol? ‘Vooral op ethisch vlak kan het spaak lopen’, stelt Spaan. ‘Bij geautomatiseerde besluitvorming op basis van algoritmes is discriminatie bijvoorbeeld een reëel risico. Als overheidsorganisatie moet je daarover nadenken: hoe organiseer je het zo dat jouw algoritmes niet discrimineren? Dat individuen en groepen burgers niet onwenselijk, onrechtmatig, of oneerlijk bevoordeeld of benadeeld worden?’

Wees transparant bij gebruik algoritmes

Als voorbeeld van een risico bij het gebruik van algoritmes noemt Commandeur de uitspraak van de rechter over de wet SyRI. ‘Deze wet moest fraude bij uitkeringen, toeslagen en belastingen bestrijden. De rechter oordeelde echter dat de wet in strijd met het recht was. Onder meer omdat de informatie die betrekking had op de werking van het risicomodel, bijvoorbeeld over het type algoritmes dat in het model werd gebruikt, niet kenbaar was gemaakt. En dus was het voor een burger niet mogelijk zich te verweren tegen een risicomelding.’ Daar zit ‘m volgens Spaan de crux bij het werken met algoritmes. ‘Je moet als organisatie kunnen verantwoorden op basis van welke informatie je tot een resultaat bent gekomen. Daarnaast moet je oog houden voor de resultaten en blijven toetsen of de uitkomsten ook begrijpelijk en verklaarbaar zijn. Die individuele toets moet je inbouwen bij het werken met algoritmes, net als de mogelijkheid om gegrond af te kunnen wijken van de uitkomsten. Ook bij de kinderopvangtoeslagaffaire is een van de maatregelen meer transparantie en openheid over besluitvorming en het gebruik van data. Kortom, je moet transparant zijn en je keuzes te allen tijde kunnen uitleggen en verantwoorden.’

Lees het hele artikel op bmc.nl >

Plaats als eerste een reactie

U moet ingelogd zijn om een reactie te kunnen plaatsen.